Tres razones por las cuales los chatbots de IA son un peligro de seguridad andante

TECNOLOGÍA Agencia de Noticias del Interior

Agencia de Noticias del Interior

Las inteligencias artificiales, sobre todo aquellas que son generativas, están diseñadas para facilitar el trabajo de programadores, fotógrafos, editores, escritores, analistas de datos, entre muchos otros. Sin embargo, su libertad de uso también hace que estas herramientas puedan ser utilizadas por malos agentes para ejecutar indicaciones que van en contra de la seguridad y privacidad de las personas en internet.

Por ejemplo, es posible ver a estafadores usar inteligencia artificial entrenada para simular la voz de una persona con la intención de solicitar un pago a un familiar cercano a modo de extorsión. También se puede usar la habilidad de programación de softwares como ChatGPT para programar sitios maliciosos. Sin embargo, así como su lista de utilidades, los riesgos que se pueden generar a partir de estos programas van en aumento.

Estos son algunos de las exposiciones o actitudes peligrosas que pueden generarse a partir de la interacción de personas malintencionadas con ayuda de algunas herramientas de inteligencia artificial:

“Liberación” de la inteligencia artificial

El uso más básico de todos los programas como ChatGPT, Stable Difussion, DALL-E, Midjourney, entre otros, consiste en establecer un “prompt” o indicación sobre la que cada inteligencia artificial podrá empezar a crear su propia interpretación del comando dado siempre y cuando el resultado con vaya en contra de los límites de su programación de seguridad.

Es decir que, por ejemplo, ChatGPT no puede ser utilizado para obtener información que podría ser potencialmente dañina para la persona que utiliza la inteligencia artificial y DALL-E no podría generar imágenes sexuales a solicitud del usuario. Sin embargo, existe una tendencia llamada “jailbreak” que consiste en crear indicaciones de tal forma que su resultado “libere” a los programas de las medidas de seguridad que fueron establecidas en ellos.

Como resultado, algunos usuarios en foros como Reddit aseguran haber logrado que ChatGPT genere respuestas violentas o deliberadamente incorrectas, apoye teorías conspirativas o que sugiera realizar actividades ilegales como robos o construir explosivos.

Asistencia en esquemas de estafas online

Aunque el riesgo de las respuestas “liberadas” de ChatGPT es considerable si se toma en cuenta que puede difundir desinformación y contenido dañino para las personas, el uso que se le da a este tipo de software también incluye la obtención de datos de alguien en internet, que puede ser particularmente vulnerable a algún tipo de estafa virtual.

Los cibercriminales, incluso, pueden manipular a los programas para obtener información sensible como el número de una tarjeta de crédito, o crear un virus usando código de programación que posteriormente sea enviado vía correo electrónico a una potencial víctima.

Por otro lado, al ejecutarse por medio de este tipo de programas, los ataques con inteligencia artificial pueden integrarse a aplicaciones de terceros que se podrían instalar en celulares y computadores de cualquier persona y ejecutar sus comandos maliciosos sin que el usuario lo reconozca fácilmente.

Envenenamiento de datos

Otro aspecto básico de las inteligencias artificiales, es que requieren de entrenamiento para que los comandos que se introduzcan obtengan resultados adecuados. Si bien algunas como ChatGPT pueden realizar un escaneo en internet para resolver algunas consultas, el entrenamiento permite el refuerzo de un tipo de información en particular.

Aún con sistemas de seguridad preventivos, es posible alimentar a las inteligencias artificiales con bancos de entrenamiento que contengan únicamente datos erróneos o información adulterada a propósito para que el software tome esas premisas equivocadas como ciertas, lo que podría generar la producción de más contenido nocivo o de baja calidad que podría arruinar la experiencia para otros usuarios e incluso llegar ser la fuente de la toma de decisiones importantes para algunas personas.

FUENTE: INFOBAE.COM

:quality(85)/https://assets.iprofesional.com/assets/jpg/2024/11/587781.jpg)

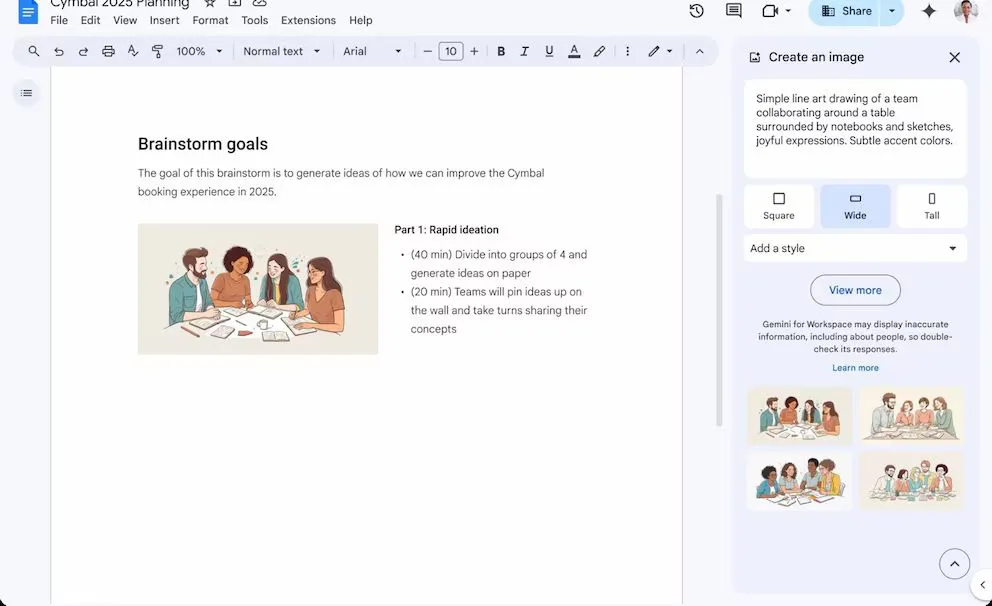

Google agrega la capacidad de generar imágenes con Gemini en Docs, impulsadas por Imagen 3

Lanzaron una startup local que ayuda a cobrar la cuota social de clubes y ONG y ya tienen clientes en 4 países

/cloudfront-us-east-1.images.arcpublishing.com/artear/GDXXDDFPD5CBXEFFK73V76RMTM.jpg)

/cloudfront-us-east-1.images.arcpublishing.com/artear/Z7US4HNNW5GSJG67IOA7QNR4BA.jpg)

/cloudfront-us-east-1.images.arcpublishing.com/artear/46WBZLYHNFFZLOGR7WVOUF5H5Y.jpg)